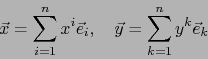

Sea ![]() un espacio de producto escalar provisto de una base

un espacio de producto escalar provisto de una base

![]() . Como de costumbre, designamos por

. Como de costumbre, designamos por

![]() la base de

la base de ![]() dual de ésta. Notamos por:

dual de ésta. Notamos por:

Puesto que ![]() es una aplicación lineal simétrica de

es una aplicación lineal simétrica de ![]() en

en ![]() la matriz

la matriz

![]() es también una matriz simétrica, o sea:

es también una matriz simétrica, o sea:

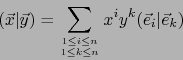

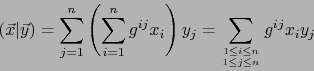

A. Expresiones de productos escalares.

Por definición del isomorfismo ![]() tenemos:

tenemos:

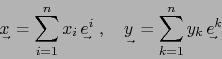

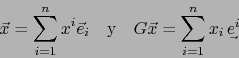

B. Componentes contravariantes y componentes covariantes de un vector. Sea

![]() un vector arbitrario. Las componentes (usuales)

un vector arbitrario. Las componentes (usuales) ![]() de

de ![]() con respecto a la base

con respecto a la base

![]() las llamaremos COMPONENTES CONTRAVARIANTES DEL VECTOR

las llamaremos COMPONENTES CONTRAVARIANTES DEL VECTOR ![]() con respecto a dicha base.

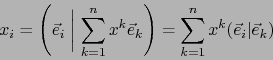

Escribimos:

con respecto a dicha base.

Escribimos:

Usando la fórmula (24) obtenemos:

Cálculo de las componentes covariantes de ![]() en función de las componentes contravariantes.

Sea

en función de las componentes contravariantes.

Sea

![]() . Por la fórmula (25):

. Por la fórmula (25):

Cálculo de las componentes contravariantes de ![]() en función de las componentes covariantes.

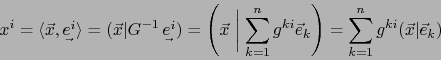

Usando la fórmula (19) obtenemos:

en función de las componentes covariantes.

Usando la fórmula (19) obtenemos:

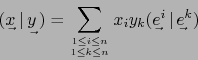

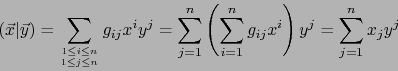

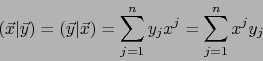

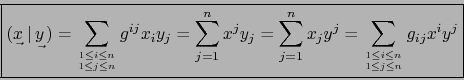

Usando las fórmulas (26) y (27) podemos transformar la expresión (22) del producto escalar. Usando (26) obtenemos:

C. Componentes covariantes y contravariantes de un covector.

Sea

Al introducir el vector

![]() transformamos las fórmulas (30) y (29) respectivamente en:

transformamos las fórmulas (30) y (29) respectivamente en:

Por lo tanto, las fórmulas (26) y (27) del descenso y ascenso del índice siguen válidas sin cambio para las componentes de misma denominación de un covector.

Finalmente, sean

![]() dos covectores y sean

dos covectores y sean

![]() los vectores correspondientes. Puesto que

los vectores correspondientes. Puesto que ![]() es una isometría de

es una isometría de ![]() sobre

sobre ![]() tenemos

tenemos

![]() , o sea, por (28):

, o sea, por (28):

Nota 1. (Sobre la terminología)

La terminología de componentes ``contravariantes'' y ``covariantes'', como la usamos, llegó a ser tradicional. Los físicos van al punto de llamar ``vectores contravariantes'' a los elementos de ![]() y ``vectores covariantes'' a los elementos de

y ``vectores covariantes'' a los elementos de ![]() . Por desgracia, según la óptica actual de la matemática, esa terminología (cuya justificación es

bastante obscura) es totalmente impropia y hasta existen buenas razones para invertirla.

. Por desgracia, según la óptica actual de la matemática, esa terminología (cuya justificación es

bastante obscura) es totalmente impropia y hasta existen buenas razones para invertirla.

En efecto, un diagrama:

En vista de ello, sería natural llamar a los elementos de ![]() entes ``covariantes'' y a

aquellos de

entes ``covariantes'' y a

aquellos de ![]() entes ``contravariantes'' en flagrante oposición con la costumbre. Dicha costumbre está, sin embargo, tan arraigada en la literatura matemática, y más todavía, física, que ni el presente autor ni probablemente ningún otro se atrevería a invertirla.

entes ``contravariantes'' en flagrante oposición con la costumbre. Dicha costumbre está, sin embargo, tan arraigada en la literatura matemática, y más todavía, física, que ni el presente autor ni probablemente ningún otro se atrevería a invertirla.

Una salida a tal dificultad podría darse en algún futuro, abandonando por completo en este contexto las palabras ``componentes contravariantes'' y ``componentes covariantes'' y substituyéndolas por otras, posiblemente más sugestivas. Yo propondría ``componentes vectoriales'' y ``componentes duales''.

En cuanto a la terminología de ``vectores contravariantes'' y ``vectores covariantes'', es afortunadamente inútil y la solución del problema es simplemente no usarla.

Nota 2.

Arriesgando un lenguaje sumamente informal, vamos a tratar de justificar ``intuitivamente'' el uso de dobles componentes.

El isomorfismo ![]() ``canónico por fuerza bruta'' de

``canónico por fuerza bruta'' de ![]() sobre

sobre ![]() , en la teoría de espacios de producto escalar, permitiría identificar

, en la teoría de espacios de producto escalar, permitiría identificar ![]() con

con ![]() . Informalmente, podemos pensar en dicha identificación y hablar, como se hace ya de manera común, de la ``autodualidad'' de un espacio de producto escalar (oficialmente no realizaremos esta identificación, pues ello

no contribuiría a la claridad de la exposición).

. Informalmente, podemos pensar en dicha identificación y hablar, como se hace ya de manera común, de la ``autodualidad'' de un espacio de producto escalar (oficialmente no realizaremos esta identificación, pues ello

no contribuiría a la claridad de la exposición).

En la óptica de la considerada identificación, un vector ![]() y un covector

y un covector

![]() tales que

tales que

![]() , equivalentemente

, equivalentemente

![]() pueden

considerarse como una misma persona con dos nacionalidades. Como

pueden

considerarse como una misma persona con dos nacionalidades. Como ![]() , dicha persona es un ciudadano de

, dicha persona es un ciudadano de ![]() , mas como

, mas como

![]() , es un ciudadano de

, es un ciudadano de ![]() . Como ciudadano de

. Como ciudadano de ![]() posee las componentes

posee las componentes ![]() con respecto a una base

con respecto a una base

![]() de

de ![]() . Como ciudadano de

. Como ciudadano de ![]() posee las componentes

posee las componentes ![]() con respecto a la base

con respecto a la base

![]() dual de la precedente.

dual de la precedente.

Algunos libros, que sus autores destinan a ingenieros o físicos experimentales, hacen la identificación ![]() implícitamente, pero radicalmente, ocultando por

completo

implícitamente, pero radicalmente, ocultando por

completo ![]() y hablando solamente del espacio de producto escalar

y hablando solamente del espacio de producto escalar ![]() . Esto les conduce a asociar con toda base

. Esto les conduce a asociar con toda base

![]() de

de ![]() a otra base del mismo

a otra base del mismo ![]() , la cual, en nuestra notación no es otra que

, la cual, en nuestra notación no es otra que

![]() y que llaman ``base recíproca'' de la anterior. La caracterizan geométricamente y prueban

que la recíproca de la última es la base inicial. Mucha perspectiva no se gana con tal enfoque, aunque sea conforme al desarrollo histórico de la teoría. En efecto, el concepto de dualidad surgió relativamente tarde en álgebra lineal.

y que llaman ``base recíproca'' de la anterior. La caracterizan geométricamente y prueban

que la recíproca de la última es la base inicial. Mucha perspectiva no se gana con tal enfoque, aunque sea conforme al desarrollo histórico de la teoría. En efecto, el concepto de dualidad surgió relativamente tarde en álgebra lineal.